Was ist der Azure Data Lake?

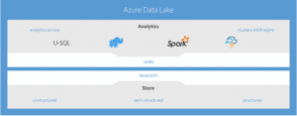

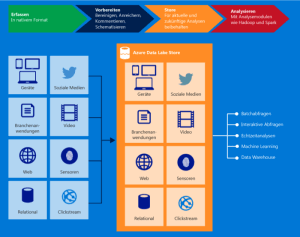

Azure Data Lake bietet eine Plattform an, in der sowohl Entwickler, als auch Data Scientists, große Datenmengen speichern und analysieren können. Dabei spielt das Format der Daten keine Rolle. Das alles hört sich zunächst nicht innovativ an, dennoch verfolgt Microsoft damit eine Vision: Azure Data Lake wird bildlich als Daten-See verstanden, den man durch verschiedene Zuflüsse befüllt. In diesem Daten-See kann man im übertragenen Sinne eintauchen, Proben entnehmen oder sogar Wasser in einem Fluss ableiten. Das wesentliche Ziel besteht darin, dem Anwender eine Möglichkeit zur Speicherung und Analyse von fast unendlich vielen Daten zu ermöglichen, ohne sich um die Dimensionierung und die performante Architektur seines Hadoop-Clusters zu kümmern. Im Wesentlichen besteht der Datensee aus folgenden Komponenten:

Komponenten des Data Lake

Abbildung: Azure Data Lake,

Quelle: Microsoft Azure

Was ist der Azure Data Lake Store?

Azure Data Lake Store (ADLS) ist ein großes Repository für Beladungen und Analysen im Big Data Umfeld. Hierbei handelt es sich um ein plattformübergreifendes Dateisystem, welches mit HDFS kompatibel ist. Über eine WebHDFS-kompatible REST-API Schnittstelle können Anwendungen auf das ADLS zugreifen. Dieser Cloud-Speicher ist ohne Beschränkung in Bezug auf Speichergröße und Anzahl der Accounts. Zudem kann man Daten als strukturiert, semi-strukturiert und unstrukturiert ablegen. Laut Microsoft ist im ADLS eine Speicherung von Dateigrößen bis in den Petabytebereich möglich. Des Weiteren verwendet ADLS das Azure Acitve Directory für die Authentifizierung und Zugriffssteuerung, sodass die Daten sicher in der Cloud abgelegt sind.

Kompatible Formate und Preise für den ADLS

Abbildung: Data Lake Storage

Gen 1, Quelle: Microsoft

Preise für das ADLS (Stand: Dezember 2016):

- Gespeicherte Daten: 0,0329€/GB pro Monat

- Data-Lake-Schreibe-Transaktionen: 0,0422€/Millionen

- Data-Lake-Lese-Transaktionen: 0,0034€/Millionen

Azure Data Lake Analytics: Azure Data Lake Analytics (ADLA) basiert auf der Cluster-Management-Technologie des Apache YARN. YARN ist ein zentraler Ressourcenmanager, der Systemressourcen prüft und steuert und die Node-Manager-Agents kontrolliert. ADLA dient zur Vereinfachung von Daten-Analysen, indem der Fokus nur auf die Erstellung, Durchführung und Administration von Aufträgen liegt und nicht auf die Skalierung und Administration der darunterliegenden Hardware. Analog zum ADLS wird auch hier die Zugriffverwaltung durch das Azure Active Directory unterstützt. Bei rechenintensiven Aufträgen werden die Ressourcen dynamisch zur Laufzeit bereitgestellt und nach der Durchführung des Auftrags wieder herunterskaliert. Somit wird sichergestellt, dass man nur für die tatsächlich in Anspruch genommenen Ressourcen bezahlt.

Preise für das ADLA (Stand: Dezember 2016)

- Analytics-Einheit: 0,8433€/Stunde

- Abgeschlossener Job: 0,0211€/Auftrag

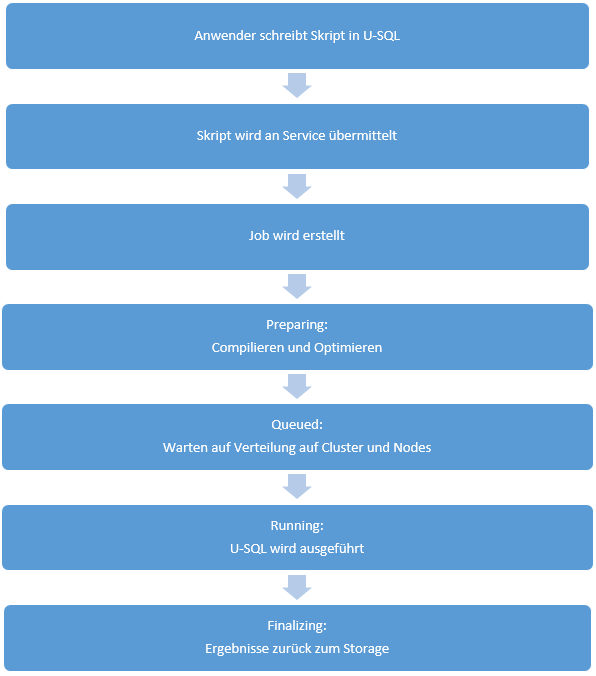

Zudem ist U-SQL ein Bestandteil von ADLA, eine deklarative SQL-Sprache kombiniert mit den Ausdrücken von C# (alle Datentypen sind als C# Datentypen deklariert). Die performante Analyse von Daten wird durch die skalierbare verteilte Laufzeit von U-SQL ermöglicht. ADLA wird als jobbasierter Service verstanden: Der Anwender übergibt dem Service die Anweisungen, die der Service dann optimiert abarbeitet. Der Ablauf eines ADLA-Services sieht wie folgt aus:

Bei weiteren Fragen rund um das Thema Data Lake können Sie uns gerne kontaktieren.